מכון Future of Life פרסם אמש (שלישי) מכתב ובו אזהרה חמורה לגבי המשך אימון ופיתוח של מערכות בינה מלאכותית ללא רגולציה מתאימה. על המכתב חתומים מספר רב של בכירים בעולם הטכנולוגיה והמדע, בהם מדען ה-AI היהודי-קנדי הבכיר יהושע בנג'יו, סטיוארט ראסל, מייסד Stability AI עימאד מוסטקי, חוקרים בכירים בחברת ה-AI של גוגל-אלפבית DeepMind, ההיסטוריון הישראלי יובל נוח הררי ואילון מאסק שמכהן כיועץ בכיר במכון.

עוד בנושא:

במכתב קוראים החותמים להשהות את ההתקדמות בתחום הבינה המלאכותית לחצי שנה לפחות - עד שיפותחו פרוטוקולי אבטחה על ידי אנשי מקצוע ושיעילותם תיבדק ותאושר, כדי שישמשו לבקרה על המשך האימון של מודלים מתקדמים. לפי סוכנות הידיעות רויטרס, מחברי המכתב כתבו כי "פיתוח של מערכות AI עוצמתיות צריך להתבצע רק לאחר שווידאנו שהשפעתן תהיה חיובית ושניתן לנהל את הסיכונים שעשויים לעלות משימוש בהן".

עוד מציינים במכתב את האיומים הפוטנציאליים שיכולים לפגוע בחברה ובאנושות משימוש ופיתוח במערכות כאלה ללא הגבלה. כך למשל סיכון אחד יכול להיות ניצול שלהן לעיוות השוק או לפגיעה במערכות בחירות בדמוקרטיות. עוד קוראים במכתב למפתחי הטכנולוגיות האלה לעבוד מול קובעי המדיניות על מנת לקבוע רגולציה יעילה ושמקובלת על כולם.

עיתוי המכתב אינו מפתיע. מאז שנחשף מודל GPT-4 החדיש ביותר של חברת OpenAI נמצאו כבר מספר דרכים להשתמש בו למטרות לא חוקיות - ממחקר של חברת אבטחת המידע צ'ק פוינט שבמסגרתו הצליחו החוקרים לגרום למערכת לספק הדרכה כיצד לפרוץ למערכות מחשבים ללא ידע מוקדם וכלה באזהרות של ארגון השיטור האירופי יורופול על כך שניתן להשתמש במערכת כדי לבצע הונאות, גניבות, פישינג והפצת דיסאינפורמציה.

המכון להגנה מסכנות הטכנולוגיה

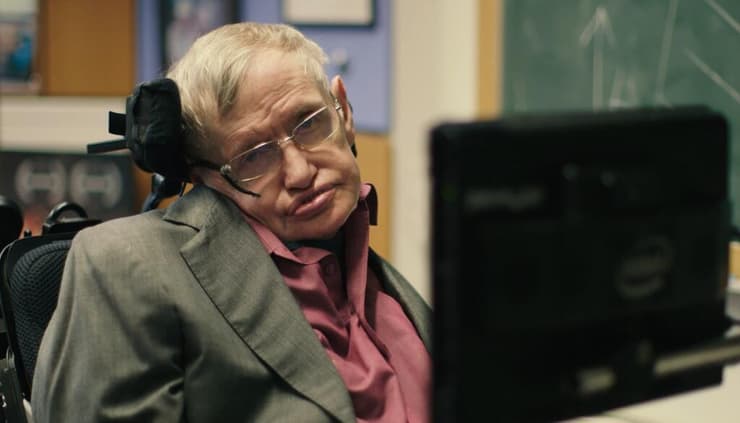

מכון Future of Life אינו זר לטיפול בבעיות אלה. מדובר במלכ''ר מכובד ביותר שהוקם תחת המטריה וסיוע של MIT, המכון הטכנולוגי של מסצ'וסטס נחשב למוסד המחקר המוביל בעולם במחקר ופיתוח טכנולוגיה. בין חברי ומייסדי המכון ניתן לציין את סטיבן הוקינג המנוח, השחקן היהודי-אמריקאי אלן אלדה, פרופ' מקס טגמארק, המיליארדר יאן טאלין שהיה ממפתחי פרוטוקול שיתוף הקבצים קאזה וכן מייסד סקייפ. מטרת המכון היא למתן את הסיכונים והאיומים על האנושות מטכנולוגיות מתקדמות כגון כלי נשק גרעיניים, ביוטכנולוגיה, וכן מאיומים הנובעים משינויי האקלים.

מאסק עצמו גם אינו זר לזהירות מופלגת משימוש בבינה מלאכותית. מנכ"ל טסלה, טוויטר וספייס X מזהיר כבר מספר שנים על הסיכונים הכרוכים בפיתוח בינה מלאכותית כללית (AIG - בינה מלאכותית בעלת יכולות המקבילות למוח האנושי ואף מעבר, ר''ק). המכון כבר פרסם ב-2015 מכתב דומה שהזהיר מפני סכנות AI, אך היה זה לפני תחילת השימוש במודלים מבוססי GPT. יש לציין שבחברת OpenAI לא חתמו על האזהרות הנוכחיות, ולמרות בקשת תגובה מהחברה וממייסדה סם אלטמן - זו סירבה להגיב.

יכול להיות שהדבר קשור לכך שמחברי המכתב ציינו ישירות את מודל GPT-4 כמודל המתקדם ביותר שלאחריו פיתוחי AI עשויים להוות חלק מהסיכונים עליהם הם מזהירים. זאת ועוד, מאסק אינו לגמרי אובייקטיבי מבחינה זו. הוא היה ממייסדי OpenAI בעצמו אך עזב את החברה לאחר שסורבה בקשתו להפוך למנכ''ל שלה. רשמית זה קרה בגלל ניגוד עניינים בין טסלה שבבעלותו לבין OpenAI בכל הנוגע לפיתוח מערכות בינה מלאכותית, במיוחד לאחר שגייס את סמנכ''ל הטכנולוגיות בחברה לטובת פרויקט פיתוח הנהג האוטומטי של מכוניות טסלה, מה שיצר סכסוך בינו לבין אלטמן. בנוסף, לפני כמה שבועות דווח כי הוא מתכנן להקים חברה שתתחרה ב-OpenAI עצמה ותפתח טכנולוגיות בינה מלאכותית מקבילות.