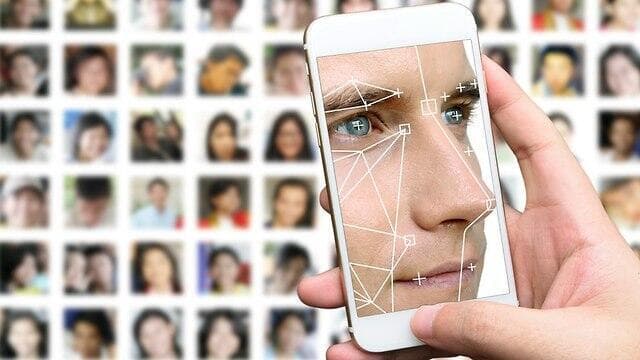

העיסוק בבעיית ה"פייק ניוז" ברחבי העולם המערבי הולך ותופס מקום מרכזי בחודשים האחרונים גם בישראל, בייחוד לקראת הבחירות לכנסת ה-21: רשתות חברתיות החליפו את מקורות המידע העיתונאיים בכותרות מקליקות ובמודעות פרסום מניבות רווחים, "עובדות אלטרנטיביות" נותנות תוקף לקבוצות שנלחמות על זכותן להתנגד לחיסונים ומחנכות לאמונה בכדור הארץ השטוח למשל, והמרחב המקוון רווי באלפי שחקני חיזוק חדשים - כולם מזויפים לחלוטין, חלקם אפילו אוטומטיים, שמסייעים בהפצת מידע שגוי, תורמים לאווירה שקרית של דיונים ציבוריים ולמצג שווא של דעת קהל רחבה. עכשיו, דמיינו שהמשתמשים המזויפים ששורצים ברשתות החברתיות היו מתהדרים בתמונות פורטרט אמיתיות לחלוטין של אנשים שפשוט לא קיימים.

זו רק דוגמה אחת ליישום אפשרי של פרצופים מבוססי בינה מלאכותית (AI) - טכנולוגיה שקיימת כבר עכשיו, אלא שאנחנו פשוט לא מודעים אליה מספיק.

בינה מלאכותית מייצרת פנים מלאכותיות וזה נראה אמיתי לגמרי

בחודש שעבר עלה לאוויר אתר שמטרתו להדגים את היכולת הזו, תחת השם "האדם הזה לא קיים". בכל רענון תקבלו פורטרט חדש, שנראה אמיתי לחלוטין: פעוטות, קשישים, נשים וגברים ממגוון של גזעים, מצולמים ברגעים ספונטניים לחלוטין ובלי שמץ של רמז לכך שמדובר בעצם בפרצופים שמיוצרים בצורה אוטומטית על ידי בינה מלאכותית. האתר נבנה על ידי מהנדס תוכנה בחברת אובר בשם פיליפ וואנג, והוא מבוסס על מחקר של אנבידיה - ספקית ערכות השבבים שעלתה לכותרות השבוע בזכות רכישת הענק של מלאנוקס הישראלית. אנבידיה שחררה גם סרטון שמסביר את התיאוריה שעומדת מאחורי היכולת הזו, ובו היא מתארת כיצד יצירת הדימויים המזויפים יכולה להיות תקפה לא רק לאנשים, אלא גם לתמונות של עצמים דוממים כמו מכוניות או בתים.

לא מוכרחים להיות מהנדסי תוכנה כדי להבין, בגדול, איך זה עובד: מדובר בעצם ברשת נוירונים ייחודית המכונה Generative Adversarial Network, או בקיצור GAN. היא ניזונה ממאגר מידע שכולל פורטרטים - תמונות פנים של אנשים מתרבויות שונות, בגילים שונים ובמצבים שונים, והיא מסוגלת לייצר על בסיס התבניות של התמונות האלה דימוי חדש לגמרי, שמבוסס על מאפיינים ודפוסים של אלפי תמונות אחרות. הדימוי החדש הזה הוא תמונת פורטרט של אדם שפשוט לא קיים. לא איור, לא דימוי שמיוצר על ידי מחשב - אלא כזה שמבוסס אלגוריתמית על אנשים קיימים.

צוות המחקר של אנבידיה הצליח לייצר תוצאות מרשימות במיוחד באמצעות מניפולציה נוספת על הרשתות הקיימות: הם קראו לזה "העברה סגנונית" (Style Transfer), והמשמעות היא שבאמצעות סולם שלם אפשר לערבל בין סגנונות שונים ולבטא אותם בתמונה החדשה, שהיא כאמור לא אמיתית כלל. אם חושבים על פילטרים פופולריים של צילום, למשל באינסטגרם, היכולת שלהם לקחת תמונה שלכם ולהפוך אותה, נניח, למעין איור נשענת בבסיסה על העברה סגנונית שכזו. מאתרים את הסגנון של איור בצבעי שחור לבן, ומערבלים אותו עם התמונה המצולמת בזמן אמת.

ריטוש ומניפולציה על תמונות ודימויים ויזואליים אינן תופעות חדשות: גם בעידן האנלוגי הונהגו שיטות לטיפול בתמונות - באמצעות הקומפוזיציה, דרגות החשיפה ואפילו בעזרת מכונות ריטוש (Retouching), שאפשרו למרוח בצורה ידנית אזורים מדויקים בתמונה (כמו עור פנים למשל), על ידי ויברציות של התשלילים בזמן הפיתוח. העידן הדיגיטלי לקח את כל אלה לרמות חדשות לגמרי. בעוד שאנחנו עדיין צריכים להזכיר לעצמנו שכמעט כל תמונה שמרוחה על שלט חוצות או על שער של מגזין עוברת ריטוש באמצעות תוכנות כמו פוטושופ - בטח ובטח שכשמדובר ברשתות החברתיות, המניפולציות רק הופכות יותר ויותר מתוחכמות, מהירות ופשוטות לתפעול.

מהסיבה הזו החליטו שני חוקרים מאוניברסיטת וושינגטון לפתח אתר-משחק, שבו המשתמשים מתבקשים לזהות מי מהפרצופים אמיתי ומי מזויף. קארל ברגסטורם וג'ווין ווסט עלו עם האתר לאוויר, כניסיון אמיתי לחנך את הציבור להתייחס לדימויים האלה בזהירות הדרושה. בריאיון למגזין The Verge הם הסבירו: "כשטכנולוגיה חדשה מהסוג הזה נכנסת לשימוש, התקופה המסוכנת ביותר היא זו שבה הציבור פשוט לא מודע לקיום שלה". את העלאת המודעות הם בחרו להשיג באמצעות משחק פשטני של זיהוי פרצופים - שאי אפשר לנצח בו. בכל פעם שתצברו רצף קצר של תשובות נכונות, תופתעו פתאום לגלות שלחצתם על פעוט שאינו בשר ודם.

בחמש השנים האחרונות חלה התקדמות מדהימה בכל מה שקשור לדימויים המיוצרים על ידי בינה מלאכותית. הקפיצה הזו היא, בין השאר, תולדה של שימוש במאגרי מידע מהסוג שעד לפני עשור היה קשה מאוד להניח עליהם את הידיים: פורטרטים מהסוג שהמחקר של אנבידיה נשען עליהם מועלים בכמויות בלתי נתפשות בכל יום לרשתות החברתיות על ידי כל אחד ואחת מאיתנו - הרגל שהפך בשנים האלה לכמעט יומיומי.

הקפיצה הטכנולוגית כוללת לא רק את הפרצופים המזויפים מבוססי הבינה המלאכותית וה-GAN, אלא גם למשל את תופעת הדיפ פייק (Deep Fake). זיופים עמוקים קשורים ביכולת של בינה מלאכותית לייצר מניפולציות אוטומטיות על סרטוני וידיאו, וגם הם הגיעו לתודעה הציבורית בזכות שימוש לרעה בטכנולוגיה - בעיקר בתחומי הפורנוגרפיה, באמצעות הדבקת פניהן של סלבריטאיות על גופן של נשים מנוצלות. הטכנולוגיות האלה גוררות גם פיתוחים מתנגדים: ישנן מספר חברות שכבר עכשיו מנסות להתמודד עם התופעה - לרוב באמצעות אימות רטרואקטיבי משפטי (Digital Forensic). הבעיה בהתמודדות הזו היא בסדרי הגודל שלה - ריבוי הזיופים והתמונות לא באמת מאפשר לאנליסטים לעבור תמונה-תמונה ולהחיל עליה תהליך סיזיפי שכזה.

אבל יש גם אפשרויות אחרות. Serelay, למשל, הוא סטארט-אפ המבוסס בלונדון אבל יש לו שורשים ישראליים. הוא עוסק באימות דימויים ויזואליים כבר ברגע הצילום - כדי להבטיח שאפשר יהיה לאמת תמונות וסרטונים מסוימים. למה רק "מסוימים?" מפני שעל פי התפישה כיום לא כל תמונה צריכה אימות שכזה, והמיקוד הוא בתיעוד שחיוני להוכיח בזמן אמת שהוא אמיתי. תיעוד לצרכים עיתונאיים או פוליטיים למשל.

אבל עד שהפתרונות האלה ייכנסו לשימוש רחב כנראה יעבור עוד זמן. בינתיים, בינה מלאכותית מצליחה להגיע להישגים מרשימים בתחומי הזיוף, והדוגמה הראשונית של משתמשים מזויפים ברשתות החברתיות היא רק קצה הקרחון. אם לוקחים כמה צעדים אחורה, מניפולציות של המדיום הוויזואלי - אף שתמיד היו חלק ממנו במידה כזו או אחרת - הולכות ומשתכללות עד כדי השפעה מכרעת על החברה. בין היתר, היכולת שלנו להאמין למה שאנחנו רואים במו עינינו צפויה לספוג פגיעה קשה, ויש לכך השלכות בתחום החברתי, המשפטי והפוליטי. תמונות וסרטוני וידיאו הם אמצעים מרכזיים במלאכת התיעוד - של עוולות חברתיות, של אירועים היסטוריים, של זכרונות פרטיים ושל התנהלות שגרתית במרחב הציבורי, ואפשר רק לדמיין את הפוטנציאל ההרסני של תמונות וסרטונים מזויפים כשהטכנולוגיה הזו מצויה בידיים הלא נכונות. איזו אחריות אפשר להטיל על פרצופו של מי שלא קיים?