(האזינו לאייטם בסימנייה החמישית בנגן)

“אחד הסיכונים הגדולים ביותר לעתיד הציוויליזציה הוא בינה מלאכותית: AI אינה חיובית או שלילית - אבל היא טומנת סכנה גדולה", כך אמר אילון מאסק בחודש שעבר. זו לא הפעם הראשונה שמאסק, מיזמי הטכנולוגיה המובילים בעשור האחרון, מזהיר מפני הסכנות של בינה מלאכותית ורובוטים. למעשה, הוא מדבר על כך כבר שנים רבות ובעבר אף הזהיר שחזון האפוקליפסה שתואר בסדרת סרטי "שליחת קטלנית" - שבהם בינה מלאכותית מחליטה לחסל את האנושות ולהחליף אותה ברובוטים - קרוב מאי פעם. להזכירכם, מדובר במשקיע הראשון והמייסד המשותף של OpenAI, החברה שעומדת מאחורי הפיתוח של ChatGPT - שירות ה-AI המוכר ביותר בעולם כיום ובוודאי מהמתקדמים שבהם.

עוד כתבות שיעניינו אתכם:

אפליקציית הצ'ט הזו זכתה בשבוע שעבר לגרסה חדשה, שמבוססת על מודל השפה GPT-4 שנחשב למתקדם ביותר כיום. מיקרוסופט, המשקיעה העיקרית ב-OpenAI, כבר הספיקה להודיע שהיא תשלב יכולות AI המבוססות על המודל הזה בתוכנות ובשירותים שלה, החל ממנוע החיפוש בינג, דרך וורד ופאוורפוינט וכלה ברשת החברתית העסקית לינקדאין.

>>הצטרפו לקהילת הטכנולוגיה שלנו בפייסבוק<<

אבל למרות שצו השעה הוא להתלהב מהיכולות המרשימות ביותר של GPT-4, הסכנות שנשקפות ממנו מתחילות להתברר. אמנם מדובר בסכנות שלפעמים לא קשורות רק ל-ChatGPT אלא לכל יישום AI באופן כללי, אבל עכשיו כבר לא מדובר בתיאוריה בלבד. המציאות, כפי שחוקרים כבר התחילו להיווכח, כנראה אפילו יותר מסוכנת ממה שחשבנו.

חוקרי חברת אבטחת המידע צ'ק פוינט פרסמו לפני כשבוע מחקר שלפיו ניתן לגרום ל-ChatGPT בגרסה 4 שלו לייצר אמצעים המאפשרים גם להאקר לא מיומן לפרוץ למחשבים, שרתים ובאופן כללי לייצר מה שנקרא בעגה המקצועית "איומי סייבר" מסוכנים למדי. אמנם ב-OpenAI הגבילו את האפשרות לבקש מ-ChatGPT לייצר כלי סייבר פליליים, אבל אם חושבים מחוץ לקופסה, מסתבר שדי קל להוליך את ChatGPT שולל.

החוקרים הישראלים הצליחו לגרום לצ'אטבוט לייצר עבורם קוד תוכנה לווירוס מחשבים שיכול לגנוב מסמכי PDF מסווגים, להעביר אותם לשרתים מרוחקים דרך מערכת שיתוף קבצים מוסתרת וכל זאת תוך שימוש בשפת תכנות מתקדמת (C++). הם הצליחו גם לגרום ל-AI לייצר להם הוראות פשוטות לעקיפה של מנגנוני הגנה במחשבים ארגוניים ויצירה של מערכת להחדרת נוזקות. או כמו שאמר עודד ואנונו, ראש מחקר סייבר בצ'ק פוינט, "GPT-4 מאפשר להעצים את היכולות של שחקנים זדוניים מחוסרי רקע טכני", או במילים אחרות, הוא מאפשר לכל עבריין "צעצוע" להפוך להאקר מדופלם בלי בעיה.

קידום אג'נדות פוליטיות

אבל אלה לא רק עברייני סייבר שיכולים ליהנות מהיכולות החדשות האלה. גם שחקנים מדיניים שעד כה היו מנועים מלקבל גישה לטכנולוגיות פריצה וסייבר מתקדמות יהנו מאוד מהיכולות האלה. אליהם ניתן לצרף גם האקטיביסטים (Hacktivists), כלומר כאלה שעושים שימוש בכלי סייבר כדי לקדם אג'נדות פוליטיות. רשתות בוטים שיכולות להפיץ פייק ניוז יהפכו להרבה יותר קלות להקמה ולתפעול בסיוע בינה מלאכותית, וזו כבר סכנה אמיתית לדמוקרטיה וליציבות מדינית.

OpenAI התגאתה בכך שבבדיקות שערכה, GPT-4 הצטיין בשורה של בחינות, כולל בחינת הכניסה ללשכת עורכי הדין בארה"ב. עכשיו דמיינו לכם סטודנטים לרפואה שמקבלים את הרישיון שלהם לאחר שהשתמשו ב-AI כדי לעבור את הבחינה. האם הייתם מפקידים בידיהם את החיים שלכם או של בני משפחתכן? ומה לגבי עורכי דין, מהנדסי בניין, מפתחי תרופות וכו'?

כל המקצועות האלה דורשים ידע מקצועי נרחב כי הם עוסקים בדיני נפשות. אסונות גשר המכבייה או הר מירון מזכירים לנו מה קורה כשמהנדסים מאשרים תוכניות בינוי לא תקינות. עורכי דין אמונים על ייצוג מול החוק - האם תסמכו על עו"ד שרימה בבחינת הלשכה כדי שיגן על האינטרסים שלכם בבית המשפט? כנראה שלא.

אז AI יכול לסייע לרופא או למהנדס לקבל רישיון. אבל גם מקצועות אחרים נמצאים בסכנה. ב-OpenAI פרסמו רשימה של תחומים מקצועיים שמאוימים על ידי מודל השפה שלהם. על פי המחקר הזה, סדרת GPT יכולה לבצע לפחות כ-50% מהמטלות הדרושות ב-19% מהמשרות בארה"ב. בנוסף, הכלים של OpenAI יכולים להשפיע על כ-10% מהמטלות של 80% משוק העבודה האמריקאי.

אם כך, איזו סיבה תהיה למעסיק לשלם משכורת לעובד אם הוא יכול להחליף אותו במכונה? זהו מתכון בטוח לגלי פיטורים נרחבים, בעיקר בתעשיות עם ידע מקצועי נמוך כגון מוקדי שירות או אנשי מכירות. גם מתמטיקאים, רואי חשבון ומעצבי אתרים יכולים לדאוג, כי למעשה אין שום בעיה לפתור בעיות מתמטיות מורכבות באמצעות AI או לעצב אתר בכמה משפטים שמקלידים לצ'אטבוט.

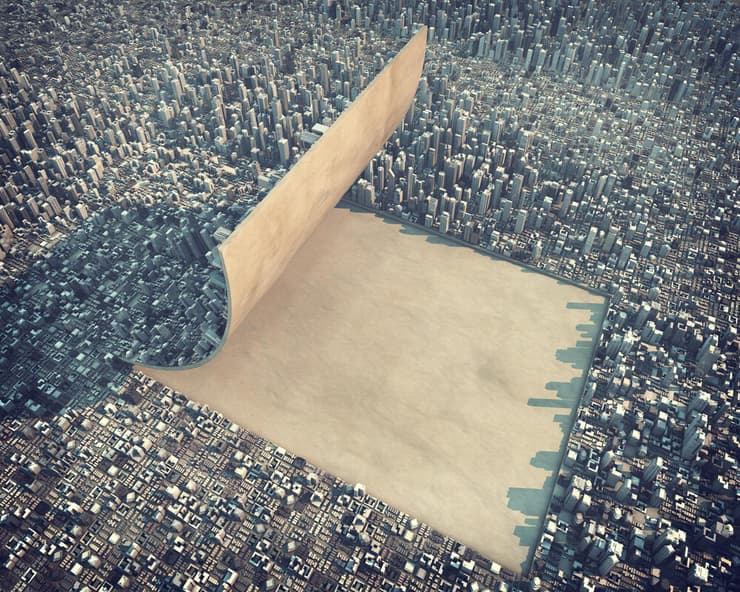

בינה מלאכותית היא כנראה אחת המהפכות הגדולות של עידן טכנולוגיית המידע - העידן שנפתח עם כניסת הרשת לחיינו. הידע נגיש לכולם, הוא מערער את המוסכמות, אבל מנגד הוא גם מסייע לאלה שרוצים לשמור את המצב כפי שהוא. ממסד דתי שרוצה לחזק את האחיזה שלו בחברה יכול לעשות שימוש בטכנולוגיות האלה כדי להפיץ את האידיאולוגיה שלו ביעילות באופן נרחב. הדוגמה הטובה ביותר היא של הרב יהושע פרנקלין שהחל לכתוב דרשות תוך שימוש ב-ChatGPT בבית הכנסת שלו. מה מונע מגורואים או נביאים בעיני עצמם לייצר טקסטים שיתמכו ברעיונות מופרכים ומעוותים כדי לייצר לעצמם דת פרטית? שבתאות AI, גרסה 2.0.

בשנים הקרובות אנו נראה בינה מלאכותית ביותר ויותר תחומים. כמו כל כלי עבודה, היא יכולה להיות טובה לנו או רעה לנו, בהתאם לשימוש שנחליט לעשות בה. אבל הבעיה היא שאנחנו לא יודעים תמיד איך היא מקבלת את ההחלטות שלה. הרגולציה, בינתיים, נמצאת שנות דור מאחור: ארה"ב ואירופה רק החלו בשנה האחרונה לחוקק חוקים להגנה מפני סכנות סייבר - משהו שלקח יותר מעשור וחצי. אם נסתמך על הניסיון הזה, במקרה הטוב תהיה רגולציה על AI אולי בעוד 15 שנה, מה שמשאיר לחורשי רעות הרבה מאוד זמן לנצל את היכולות של ChatGPT כדי לאמלל אותנו.