בית חולים בעזה נפגע ומאות אנשים נהרגו. סטודנטים מעלים פוסטים במדיה החברתית ומביעים דעה על מתקפת הטרור הרצחנית ב-7 באוקטובר, על חמאס ועל הסכסוך הישראלי-פלסטיני. רשת מזון מהיר מצהירה על תמיכה מוחלטת בפלסטינים ותתרום דולר על כל ארוחה. לכאורה, עובדות ותו לא. אבל בעולם המודרני של המאה ה-21, עובדות אינן רק עובדות.

האם בית החולים נפגע כתוצאה מירי כושל שביצע הג'יהאד האיסלאמי סמוך לבית החולים תוך סיכון של מאות החולים, כפי שמראות העדויות שפרסם דובר צה"ל, או שמא מדובר בהתקפה ישראלית? האם מדובר בסטודנטים תומכי חמאס אשר עלזו על מה שקרה בעוטף עזה או באנשים עם דעה מגובשת על האופן שבו ניתן לפתור את הסכסוך הישראלי-פלסטיני? והאם רשת המזון המהיר אכן פתחה בקמפיין תמיכה כפי שדווח?

עוד כתבות שיעניינו אתכם:

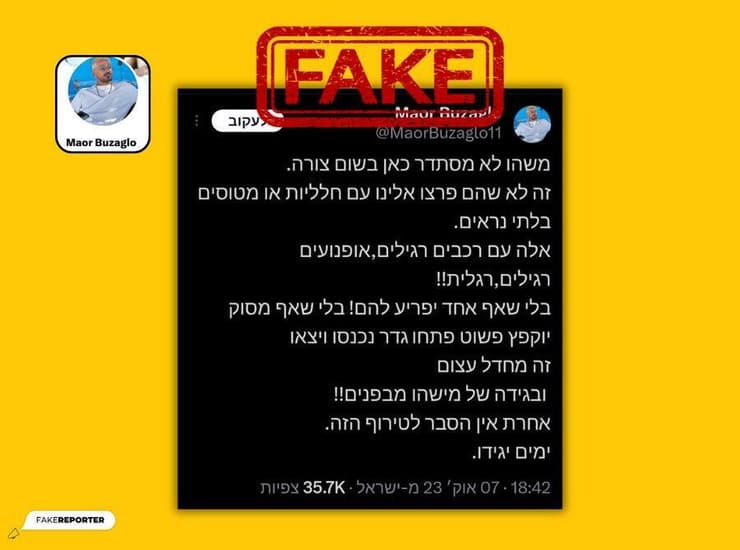

תחום מחקר עכשווי ומשמעותי מאוד לימים אלו, הוא נושא חדשות הכזב (פייק ניוז). מדובר בידיעות שקריות באופן מכוון המופצות כידיעות אמיתיות באתרים ציבוריים לשם הטעיה. חדשות כזב קשות היום יותר מתמיד לזיהוי בשל טכנולוגיות דיפ פייק שמאפשרות לייצר תמונות, הקלטות וסרטונים שנראים אמיתיים אך הם למעשה תוצרים של אנימציית מחשב. בנוסף, הדמוקרטיזציה של ערוצי התקשורת מאפשרת העברת מידע לא רק בערוצים שהיו מקובלים בעבר, עיתונות, רדיו וטלוויזיה, אלא גם (ובעיקר) בערוצי מדיה חברתית כדוגמת פייסבוק, X (טוויטר לשעבר), אינסטגרם וטיקטוק.

ריפרש

ברוכים הבאים לטלגרם, חמאס כבר כאן / עם עידן רינג

21:29

דמוקרטיזציה זו נשאה בחובה הבטחה גדולה, נגישות למידע לכל דורש ולא רק למעטים. בפועל, מה שקרה הוא שערוצי המדיה החברתיים יצרו תאי הדהוד (echo chambers) אשר מדווחים באופן מוטה בהתאם לנטייה פוליטית ומונעים גישה למידע רלוונטי. כך, משתמשים פרו-פלסטינים לא ייחשפו למידע מדובר צה"ל, אשר מספק תיעוד לכך שהג'יהאד האיסלאמי הוא שפגע בבית החולים בעזה; ערוצי התלהמות באוניברסיטאות לא יקבלו גישה למידע שמגיע מראשי האוניברסיטאות או למאמרי דעה שמסבירים את מגבלות הכוח של המוסדות האלה והצורך בשיקול דעת; ובכל הנוגע לרשת המזון המהיר, האם הכחשה של הנהלת הרשת בכלל תמצא את דרכה לערוצים שבהם הופץ מידע זה מלכתחילה?

שלוש חזיתות

הפתרון להתמודדות עם בעיית חדשות הכזב הוא רב-שכבתי והוא כולל רובד טכנולוגי, רובד רגולטורי ורובד חינוכי.

בעת הזאת, כאשר ישראל חווה את אחת התקופות הקשות ביותר בהיסטוריה שלה, אנו עדים להשפעה של מדעי הנתונים בכלל, ובינה מלאכותית בפרט, על האופן שבו מלחמות מנוהלות וניצחונות מושגים. מסדי נתונים, בינה מלאכותית ולמידת מכונה משפיעים עתה על כל תחומי החיים כולל שוק העבודה, חינוך, תחבורה, רפואה ועוד. לכן, בהיבט הטכנולוגי, כיום יש כלים בארגז הכלים של מדעי הנתונים אשר מאפשרים לייצר אלגוריתם לומד אשר יכול להתריע מפני חדשות כזב. השימוש המיידי של טכנולוגיה זו מאפשר לציבור חשיפה מבוקרת לתכנים וגם זיהוי והסרת תכנים שקריים מאתרים. ההתארגנות האזרחית שאנו רואים כיום ברשתות מאתרת בין היתר חדשות כזב ומסתייעת בציבור כדי לדווח עליהן ולדרוש את הורדתן מהרשת. עם זאת, כמו כל פתרון טכנולוגי ראשוני, אלגוריתמי הזיהוי חשופים לטעויות ולהטיות אשר נובעות מזמינות נתונים. מחקר אקדמי נוסף נדרש על מנת לשפר את איכות האלגוריתמים הקיימים.

אביגדור גלצילום: גיורא מייזלר

אביגדור גלצילום: גיורא מייזלרבהיבט הרגולטורי, קובעי המדיניות צריכים לייצר בסיס חוקי ונורמטיבי להתנהלות עם חדשות כזב. נניח שאלגוריתם זיהה ידיעה כידיעת כזב, מהי חלוקת האחריות על הפרסום בין כותב הידיעה והגוף אשר מפרסם אותה? מהי הפעולה שבה יש לנקוט? האם יש צורך בהסרה מיידית של הידיעה או שמא די לפרסם אותה עם הערכה לגבי מידת אמינותה? כמו בכל תחום אחר שבו כלי בינה מלאכותית תופסים מקום נכבד, בשגרה כמו גם בעיתות חירום, חובה עלינו להבין מה כלים אלו עושים, כיצד הם מגשימים את מטרתם ובעיקר האם כלים אלו תואמים את העקרונות האתיים שלאורם אנו נדרשים לפעול. האם ההחלטות האלגוריתמיות שאנו נותנים למערכות בינה מלאכותית לבצע הן הוגנות? עד כמה הן פוגעות בפרטיות שלנו? מהן הסמכויות אשר נרצה להקנות לממשלה בשימוש בכלים אלו והאם החופש שלנו (חופש העיסוק, חופש התנועה, החופש להבעה עצמית ועוד) נשמר בעולם שבו טכנולוגיות מדעי הנתונים שולטות. גם בתקופות חירום, שבהן ניתנות סמכויות רחבות לגופי הביטחון, יש צורך בבקרה שיפוטית ורגולציה קפדנית שיוודאו שנעשה שימוש הולם בכלים של מדעי נתונים וששימוש זה תחום בזמן לתקופת החירום ולא הופך להיות כלי בידי שלטון סורר כנגד אזרחים.

2 צפייה בגלריה

הרשתות החברתיות יוצרות תאי הדהוד

(עיבוד תמונה. צילום: Thaspol Sangsee / Shutterstock.com, MAHMUD HAMS / AFP)

ההיבט החינוכי כולל אוריינות דיגיטלית לציבור הרחב, מתן כלים להטלת ספק בידיעות אשר אנו נחשפים אליהם, ושיטות לווידוא האמינות של ידיעה ושל המקור שממנו היא הגיעה. בגדול, כל אחד ואחת מאיתנו חייבים לקבל חינוך של עיתונאי-חוקר, כולל היכולות להצליב מקורות ולהבין מהם מאפיינים ברורים של ידיעות כזב. גם כאן, הטכנולוגיה יכולה לבוא לעזרתנו, אך עלינו לחדד את יכולתנו להפעיל שיקול דעת בכל הקשור להתראה של כלי בינה מלאכותית בפני חדשות כזב.

ידיעות כזב הן תוצר של ההתפתחות הטכנולוגית המדהימה של העשור האחרון. היכולת לייצר תוכן באיכות גבוהה שזמינה כיום לכל דכפין, הרשתות החברתיות שמעלימות מאיתנו (במתכוון או שלא במתכוון) תכנים שאיננו מרגישים עמם בנוח והמהירות הגבוהה שבה ניתן להפיץ פוסטים ויראליים מייצרים אתגר משמעותי ליכולת שלנו להבין את הנעשה סביבנו ולאמת את המידע אשר זורם אלינו. האבולוציה הקנתה לנו יכולות קבלת מידע מהסביבה באמצעות חושינו, אך אם הדיפ פייק מבצע מניפולציות על חושים אלו, אנו נזקקים בדחיפות לכלים חדשים שיסייעו לנו להבדיל בין אמת לכזב. הפתרון טמון במדעי הנתונים, אך כל פתרון טכנולוגי זקוק למעטפת רגולטורית לפעולה ואוריינות אנושית לשימוש יאות ומושכל באלגוריתמים.

פרופ' אביגדור גל הוא פרופסור בפקולטה למדעי הנתונים וההחלטות בטכניון ויועץ בתחום האתיקה לרשות החדשנות בישראל ולקונגרס האמריקאי