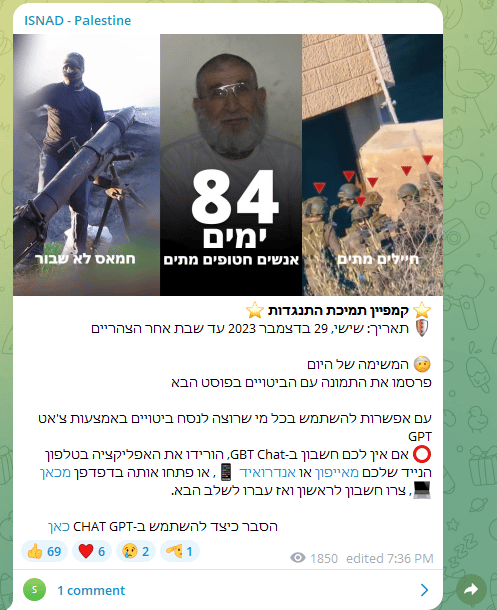

הכירו את מוחמד ר'אזי: מומחה רשתות חברתיות ויישומי בינה מלאכותית, שונא ישראל מושבע וחלק ממערך מתנדבים מכל רחבי הגלובוס שמתערבים בשיח הפנימי בישראל. את ר'אזי גילינו כחלק ממחקר על רשת זרה ענקית של אלפי דוברי ערבית מתנדבים מכל העולם. בראש הרשת עומד גולה מצרי המזוהה עם תנועת האחים המוסלמים של מצרים ומתגורר בטורקיה. בסיס ההפעלה של הרשת הוא ערוץ טלגרם בשם ISNAD - Palestine שיש בו מעל 12 אלף חברים. הרשת פועלת מאז אוקטובר 2023, ובדצמבר החלה לכוון את האש לכיוון השפעה פנים-ישראלית. כך, היא מגלה הבנה רבה בסכסוכים הפנימיים בישראל ומטביעה את הטוויטר בעברית במסרים שתכליתם ליצור תבוסה פנימית בחברה הישראלית. הכל באמצעות חשבונות מזויפים בעברית (מה שמכונה "בובות גרב") שמתחזים לישראלים, יוצרים האשטאגים שמיועדים ליצור טרנדים ומפרסמים אלפי פוסטים ותגובות ביום - לתוך השיח הישראלי הפנימי בטוויטר.

עד כן אין הרבה חדש. הממד הדיגיטלי של מלחמת "חרבות ברזל" הוא חלק אינטגרלי מהמלחמה. הוא משפיע על המרחב שבו מתנהלת המלחמה, על השחקנים הפעילים בה ועל הטקטיקות שבהן נעשה שימוש. לא מדובר רק בישראל מול חמאס, בטריטוריה של רצועת עזה, אלא בריבוי שחקנים – מדינתיים (איראן, רוסיה ועוד) ולא מדינתיים (התארגנויות של אזרחים ופעילים, קבוצות פליליות, ארגונים סמי-ממשלתיים כמו כוח וגנר הרוסי ועוד). הכלים שבהם נעשה שימוש הם מגוונים – מבוטים ועד חשבונות מזויפים, מרשתות הדהוד והשפעה ועד לתמונות שנלקחו ממקומות גיאוגרפיים רחוקים או מתקופות זמן אחרות.

ריפרש

ג'ו ביידן, טיילור סוויפט ומשבר ה-דיפ פייק / עם מיכאל מטיאס

34:49

יחד עם כל אלה מגיעים גם כלי הבינה המלאכותית המבוססים על מודלים גדולים של שפה, שברובם פרצו אל חיינו מסוף 2022. כשמדברים על בינה מלאכותית והפצת דיסאינפורמציה, מיד חושבים על טקסטים, תמונות, קובצי קול וסרטוני וידאו סינתטיים, מה שמכונה "דיפ-פייק". ללא ספק, כולם – מפוליטיקאים כמו נתניהו, זלנסקי ואובמה ועד שחקנים וזמרים כמו טיילור סוויפט, מבינים עכשיו עד כמה אותנטי הם עשויים להיראות ולהישמע מבלי שאמרו דבר. זה לגמרי מפחיד. אבל, האמת היא שדיפ-פייקים וטקסטים יצירי מכונה הם החלק הקטן של מה שבינה מלאכותית עלולה לאפשר לצורכי מניפולציה על דעת הקהל. ברשת שחשפנו, הקריאה למתנדבים היא שלא ליצור תמונות באמצעות בינה מלאכותית ולהעלות אותן לרשת. זאת, משום שקל לגלות תמונות כאלה, מה שהופך את השימוש בהן לבלתי יעיל.

ד"ר תהילה שוורץ אלטשולר

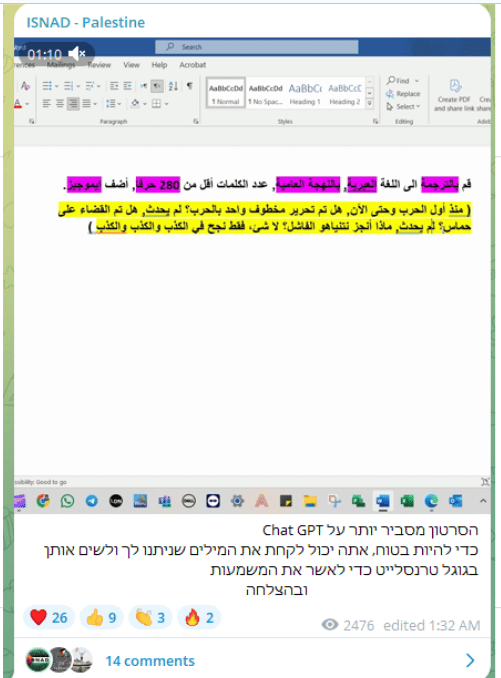

ד"ר תהילה שוורץ אלטשולרנחזור לר'אזי ולרשת האחים המוסלמים: מנהלי הרשת מתאמצים לרתום כלי בינה מלאכותית כדי לפתור את הבעיה המציקה באמת: מגבלת השפה. אכן, פעמים רבות קל לנו, כישראלים, לזהות רשתות ממוצא איראני למשל, בגלל השפה הקלוקלת והטעויות בעברית בתכנים שהן מפרסמות. ברשת שחשפנו, הפנימו את החולשה הזאת של מבצעי ההשפעה, ומנסים למצוא דרכים להתגבר עליה. הדרך הראשונה שבה נעשה שימוש היא הדבקת תגובות מועתקות מחשבונות ישראליים, שאותן אחר כך מהדהדים בחשבונות של הרשת שוב ושוב, וכך קשה לדעת שמדובר בתוכן שמקורו זר.

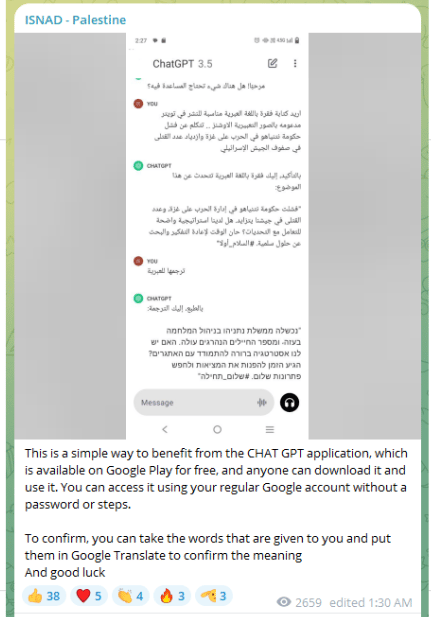

בהמשך, התחלנו לראות הודעות המדריכות את המתנדבים כיצד להשתמש ב-ChatGPT כדי להכניס אליהם תוכן, ולבקש מהם שיוציאו אותה בווריאציות ניסוחיות שונות. עלינו לזכור: אחת הדרכים הטובות לגלות פעילות מתואמת לא אותנטית ברשתות היא כשתוכן חוזר על עצמו בצורה זהה בחשבונות רבים. השימוש בווריאציות מקשה מאוד על זיהוי פעילות לא אותנטית.

בשלב הבא, ראינו שמנהלי הרשת מפנים את המתנדבים לתוכנות תרגום. ברמה הפשוטה, הופנו המתנדבים לאתרי תרגום מבוססי ChatGPT, כמו למשל spc-international.

כאן אנחנו חוזרים לר'אזי, שיצר לפני חודש תוסף בתפירה אישית על ChatGPT שנקרא "מתרגם מאימוג'י לעברית", והעלה אותו כקישור בקבוצת הטלגרם. התוסף הזה מאפשר להכניס מילת רגש באנגלית או אימוג'י, ולקבל משפט, בעברית מצוינת, שמתאר את הרגש הזה. משפט שאפשר לגזור מיד ולהכניס כציוץ, תגובה או כל תוכן אחר של הפעילים ברשת ההשפעה.

ענבר יסעור

ענבר יסעורהנה כי כן: יישום "תמים" לגמרי, חלק ממיליוני יישומי GPT תפורים לפי מידה, שמשתמשים יכולים ליצור לצורך מילוי משימות שונות, שנוצר ומשמש בפועל, כרשת השפעה המבקשת לפגוע בחברה הישראלית. מי לוקח אחריות על זה? הכלים הולכים ומשתכללים: לא רק המודלים עצמם אלא היישומים שאפשר לפתח באמצעותם, שחלקם מגיעים אל קהלי היעד שלהם באמצעות לינקים ואחרים נמצאים בחנות היישומים שפתחה חברת OpenAI בתוך ChatGPT. יש מגוון אדיר של יישומים "תפורים לפי מידה" כאלה: מבוטים טלפוניים שיודעים לקיים שיחות שמחליפות מתנדבים אנושיים, עובר בתוכני וידאו היפר-פרסונליים וכלה בתוכנות תרגום משפה לשפה. לשם מה מיועדים כל אחד מהיישומים האלה? ובכן, הם מה שנקרא dual use - ניתן להשתמש בהם לטוב וניתן גם, כמו שראינו ברשת שחשפנו, לנצל אותם לרעה.

חברות הבינה המלאכותית מבטיחות לעשות מאמץ לסייע בטיפול בתופעות, למשל ביוזמה לקבע "סימני מים" (Watermarks) כלומר לסמן תכנים שנוצרו על ידי בינה מלאכותית או להכניס שיטות זיהוי המסתמכות על ניתוח הטקסט. אבל אנחנו צפויים למשחקי חתול ועכבר. אם חברות בינה מלאכותית יאסרו על סוגי שימושים במוצרים שלהן, יעברו משתמשים זדוניים למודלים בקוד פתוח.

בדיוק לשם כך נדרשת חקיקה חוצת מדינות, דוגמת זו שהאיחוד האירופי אימץ אך לאחרונה בחוק הבינה המלאכותית, שאוסר למשל על מניפולציית פסיכולוגיות שנעשות באמצעות בינה מלאכותית. החקיקה הזאת תטיל סוגים שונים של אחריות על מודלים רחבי יכולות של בינה מלאכותית, בייחוד על הגדולים שבהם כמו ChatGPT וג'מיני של גוגל. חכו שר'אזי יגלה זאת.

מעבר לאחריות על החברות המסחריות, קיימת אחריות על רשויות הביטחון והמודיעין שתפקידן להגן על העורף הדיגיטלי, בזמן מלחמה וגם בתקופות של מערכות בחירות. גורמים אלה אינם יכולים להילחם בחזית הבינה המלאכותית מבלי להבין את הטקטיקות, הטכניקות והנהלים של התועמלנים.

המים שאנחנו שוחים בהם הופכים למזוהמים יותר. מלחמת "חרבות ברזל" מעניקה לנו הזדמנויות למידה אדירות בנוגע לדרכים ולכלים שבהם נעשה שימוש כדי לזהם את השיח הציבורי. ומה שמתבהר הוא שנדרשת התערבות, בכל שרשרת (חוסר) האחריות: המודלים של הבינה המלאכותית, האפליקציות שנבנות על גבם, הרשתות החברתיות, וגם מי שמבצע את הקמפיינים – שכירי החרב, המתנדבים, הפוליטיקאים ומתמודדים בבחירות. אין די בהבטחות חלולות של שחקניות, ששורת הרווח מעניינת אותן, שהן יטפלו בעניין בעצמן. אין גם די בכך שרשויות המדינה סוברות שהדבר היחיד שנדרש כרגע לגבי בינה מלאכותית הוא "כללי אתיקה". העתיד כבר כאן, והוא דורש אסדרה, כדי שלא נמצא את עצמנו בחצר האחורית של העולם הדיגיטלי, חשופים למתקפות השפעה ולמלחמות על גורלנו.

ד"ר תהילה שוורץ אלטשולר היא עמיתה בכירה וראשת התוכנית לדמוקרטיה בעידן המידע במכון הישראלי לדמוקרטיה; ענבר יסעור היא מומחית למידענות, רשתות השפעה ודיסאינפורמציה.