לא גבר ולא אישה: גוגל נאבקת בהטיה מגדרית

ענקית הטכנולוגיה מבטלת את ההבחנה בין גבר לאישה בכלי בינה מלאכותית מרכזי, לטובת הסיווג הכללי Person. הסיבה: אי אפשר לקבוע שיוך מגדרי לפי סממנים חיצוניים כמו חצאית או שיער ארוך. האם מדובר בפריצת דרך לקראת ביטול ההטיה המגדרית בתחום ה-AI?

"אישה לא נולדת אישה, היא נעשית אישה", יודעת לדקלם כל סטודנטית בחוג למגדר, אבל הציטוט המכונן הזה של סימון דה-בובואר מתוך "המין השני", התנ"ך של תיאוריות מגדריות, שנכתב איפשהו באמצע המאה הקודמת, הצליח לחלחל הרבה מעבר לכותלי האקדמיה. ההבנה שתפקידים מגדריים, מה שהופך אותנו לגברים או לנשים (ולמיטיבי לכת - גם לנקודות על הרצף שבין גבר לאישה) הוא תלוי הבניות חברתיות-תרבותיות ובעל השלכות פוליטיות מרחיקות-לכת, היא כזו שבעידן ה-MeToo, ובמציאות שבה נשים עדיין משתכרות כ-30 אחוז פחות מגברים, כבר בלתי אפשרי להתעלם ממנה.

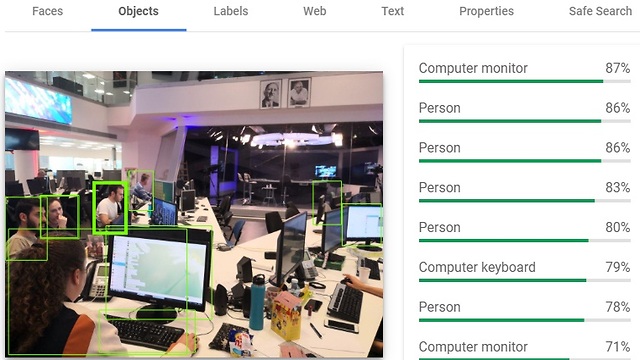

בתוך התנועה הפמיניסטית יש גישות שונות להתמודדות עם מציאות חברתית מתמשכת של אי-שוויון, אבל יכול להיות שדווקא מתוך הטכנולוגיה תגיע בשורה: בחודש שעבר הכריזה גוגל כי היא משליכה את ההבחנה הבינארית שבין גבר לאישה מכלי בינה מלאכותית מרכזי, ה-API של Google Cloud Vision המשמש לסיווג דמויות ואובייקטים בתמונות. במקום הבחנה בין גבר (Man) לאישה (Woman), הכלי הזה יציג למפתחים המשתמשים בו דמויות אנושיות תחת הסיווג הלא ממוגדר Person. השינוי הזה יוצא מנקודת הנחה שאי-אפשר לקבוע שיוך מגדרי על בסיס סממנים חיצוניים, כמו שיער ארוך או חצאית, למשל.

הצעד החשוב הזה מגיע אחרי שנים של עיסוק בהטיות מגדריות (וגם כמובן גזעניות ואחרות) בתחום של בינה מלאכותית ואלגוריתמים. במקום לפתח ולתכנן כלים מבוססי בינה מלאכותית שיפעלו לפי האידיאל, גילינו במהרה שהתחום הזה משכפל מציאות לא רצויה ולא שוויונית. קל להבין למה: על שולחנות השרטוט בעבודה על אלגוריתמים יושבים בדרך-כלל גברים לבנים, פריווילגים מספיק כדי לקיים קריירה בתחום ההיי-טק, שלא נאלצו לבעוט בהסללה בדרך לתפקידים משמעותיים בענקיות הטכנולוגיה.

והנה כמה מהדוגמאות היותר מדוברות של השנים האחרונות: סייעות קוליות ממוגדרות לרוב כנשים, מעודדות סקסיזם

ומשכפלות את התפקיד המגדרי השכיח ביותר של נשים, ה"עזר כנגדו", המזכירות, הכפופות לבוס; אלגוריתם לזיהוי תמונות שסימן באופן עקבי נשים כהות-עור כגורילות; אלגוריתם למיון קורות-חיים העדיף גברים על פני נשים; כלים של תרגום אוטומטי ממשיכים להניח שמקצועות מסויימים הם גבריים או נשיים

(המילה Doctor היא אוטומטית רופא, והמילה Nurse היא אוטומטית אחות); ואלה רק המקרים המפורסמים.

המציאות הזו משתנה, אבל לאט. יותר ויותר חברות טכנולוגיה מדגישות היום את הנושא של גיוון מגדרי, אתני ותרבותי - לא רק כמס שפתיים או מתוך ניסיון לקדם תדמית חיובית, אלא מתוך הבנה אמיתית שפתרונות מגוונים וכוללים הם טובים יותר לחברה כולה, וכן, גם לעסקים עצמם. מעבר לזה, בינה מלאכותית נשענת על מאגרי נתונים, והם לא מגיעים יש מאין. אלגוריתמים שעובדים על כלים של תרגום למשל, שואבים מטקסטים קיימים - ואלה, כפי שאנחנו יודעות ויודעים, נגועים מראש בהטיות מגדריות.

מאחורי הצעד של גוגל עומדת ג'וי בוולמוויני, מהנדסת תוכנה אפרו-אמריקאית בת 31, מייסדת ארגון בשם "ליגת הצדק האלגוריתמי" הנאבק בהטיות (Bias) בתחום של בינה מלאכותית. בריאיון לביזנס אינסיידר, אמרה: "המהלך של גוגל שולח מסר שבחירות תכנוניות יכולות להשתנות. בתחום של טכנולוגיה, קל לחשוב שיש דברים שבלתי אפשרי לשנות, שהם בלתי נמנעים. זה לא בהכרח נכון".

עכשיו היא קוראת גם לענקיות טכנולוגיה נוספות שבבעלותן כלים מבוססי בינה מלאכותית לאמץ את הדרך החדשה של גוגל. ווטסון של IBM, רקוגנישן של אמזון ואז'ור לזיהוי פנים של מיקרוסופט - הם כלים שעוסקים בסיווג אוטומטי של תמונות, ושאפשר לתכנן אותם מחדש כך שלא יבצעו הבחנה מגדרית בזיהוי של בני-אדם. כלים אלה נבחנו על ידי בוולמוויני במחקר משנת 2018, אז היא הוכיחה שבמקרים של נשים כהות-עור, בינה מלאכותית מתקשה לתת סיווג מגדרי נכון לתמונות.

ההתקדמות המשמעותית בתיאוריות של מגדר גם היא מכרעת בסוגיות האלה. תאי שירותים לא ממוגדרים הם תוצאה ישירה של ההתקדמות הזו, שנובעת מההבנה שמין (זכר, נקבה ומה שביניהם) ומגדר (גבר, אישה ומה שביניהם) הן הגדרות מובחנות ולא בהכרח תואמות עבור הרבה אנשים. שאפשר להיות ולהזדהות כאישה או גבר בלי קשר לאיברי הרבייה, שיש קשת שלמה של אנשים שההגדרות האלה מדירות אותן. סיווג שנשען על ההבחנה בין גבר לאישה, זכר לנקבה, גם מניח מראש שמדובר בהגדרות בינאריות - בעוד שהיום אנחנו כבר יודעים להכיל ולהכיר שמדובר ברצף.

בהנחה ומדובר בצעד ראשון מתוך שורה של מהלכים לתיקון ההטיות המובנות בבינה מלאכותית, קשה להקל בו ראש. במקום שאלגוריתמים וכלים אוטומטיים וחכמים ישכפלו עוולות חברתיות, יש בכוחנו לעצב אותם כך שהם ייצרו תיקון אמיתי - ברוח של מציאות אוטופית, שתחלחל בסופו של דבר בחזרה אלינו. אם כלי אוטומטי מבוסס בינה מלאכותית מסרב להניח את המגדר של האיש.ה שניצב.ת מולו - מי אנחנו שנמשיך לעשות את זה?